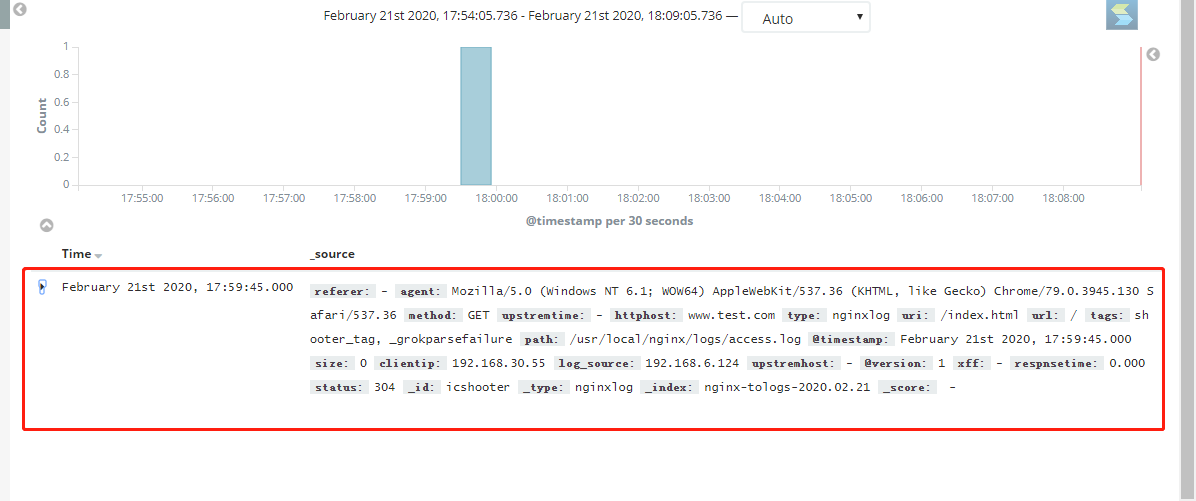

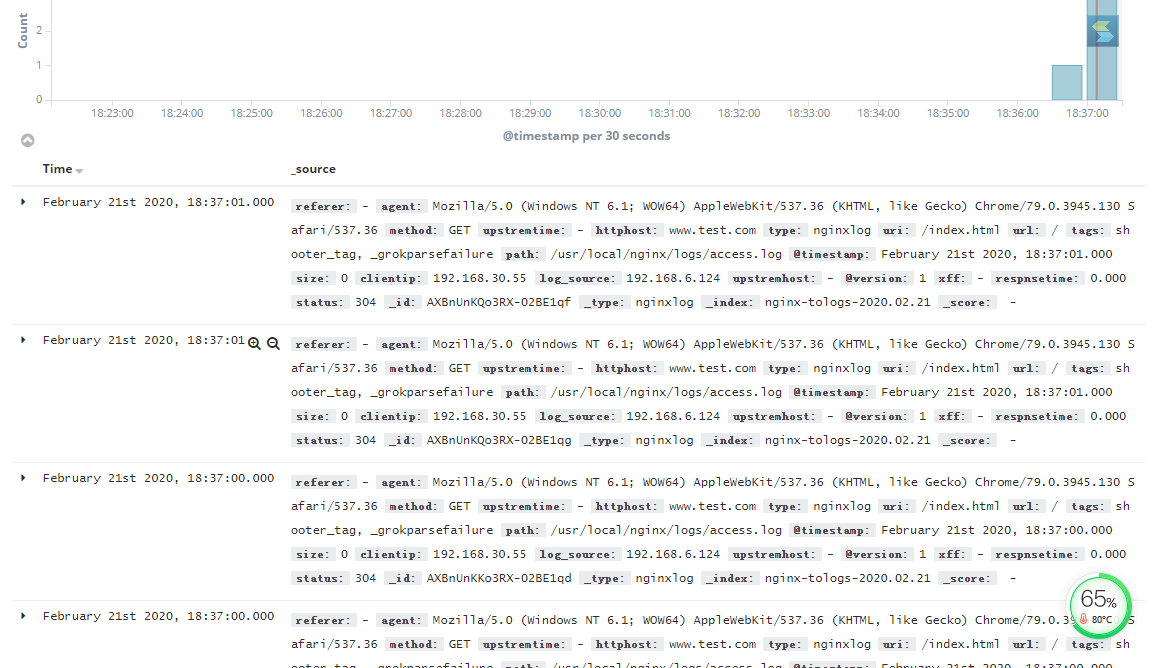

如下图,永远只有一条日志数据,且是最新的一条

永远都只有这一条,日志表里最新的一条,最后一条

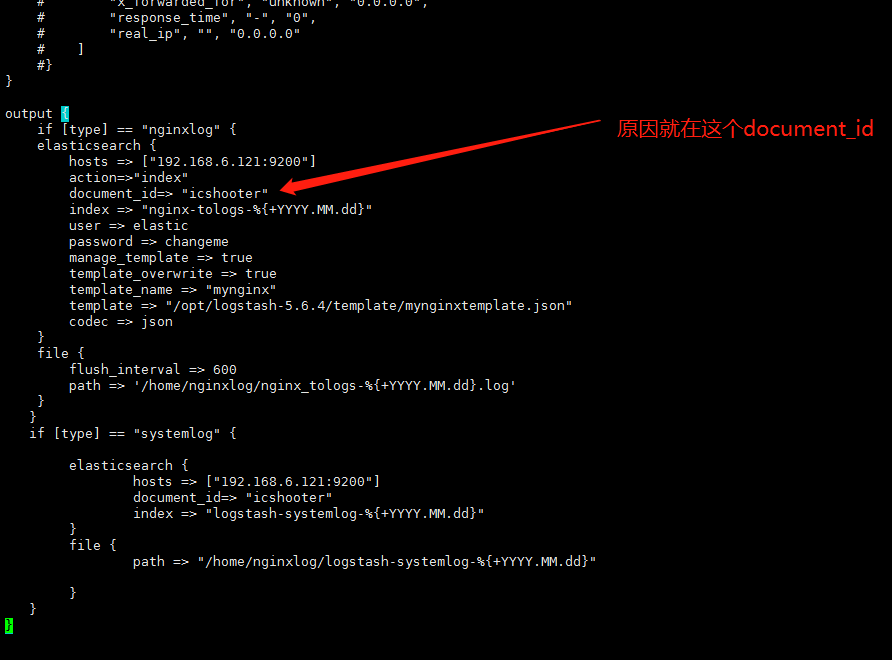

原因:

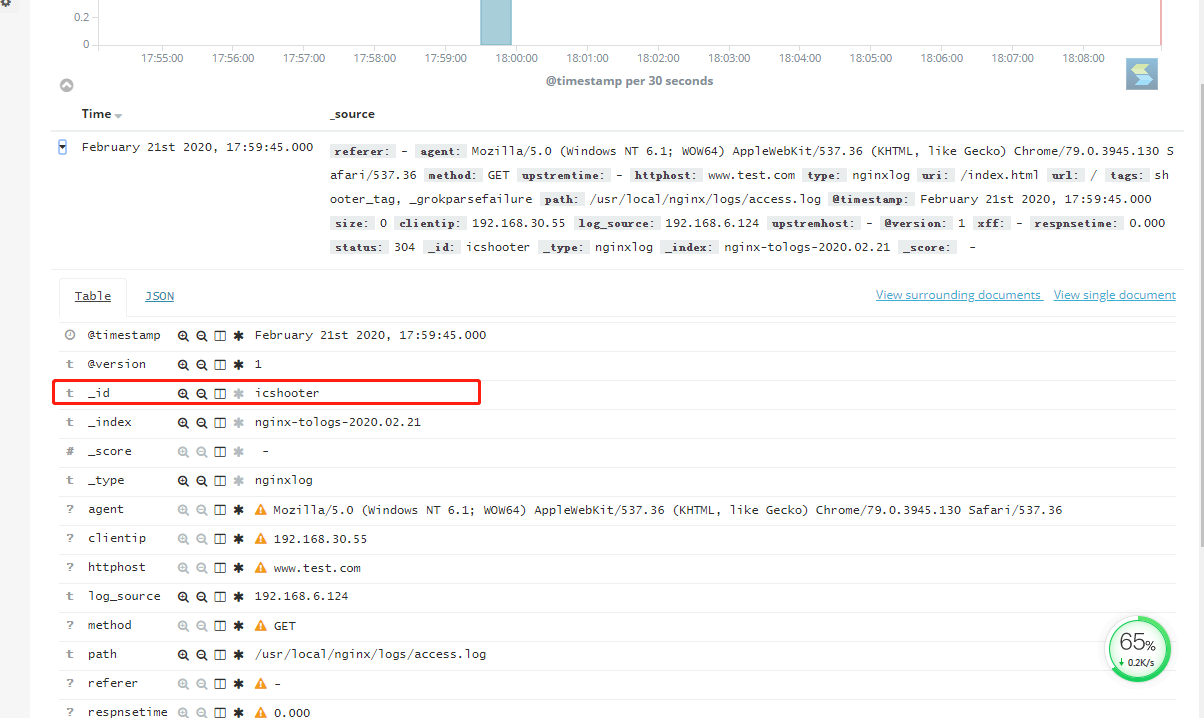

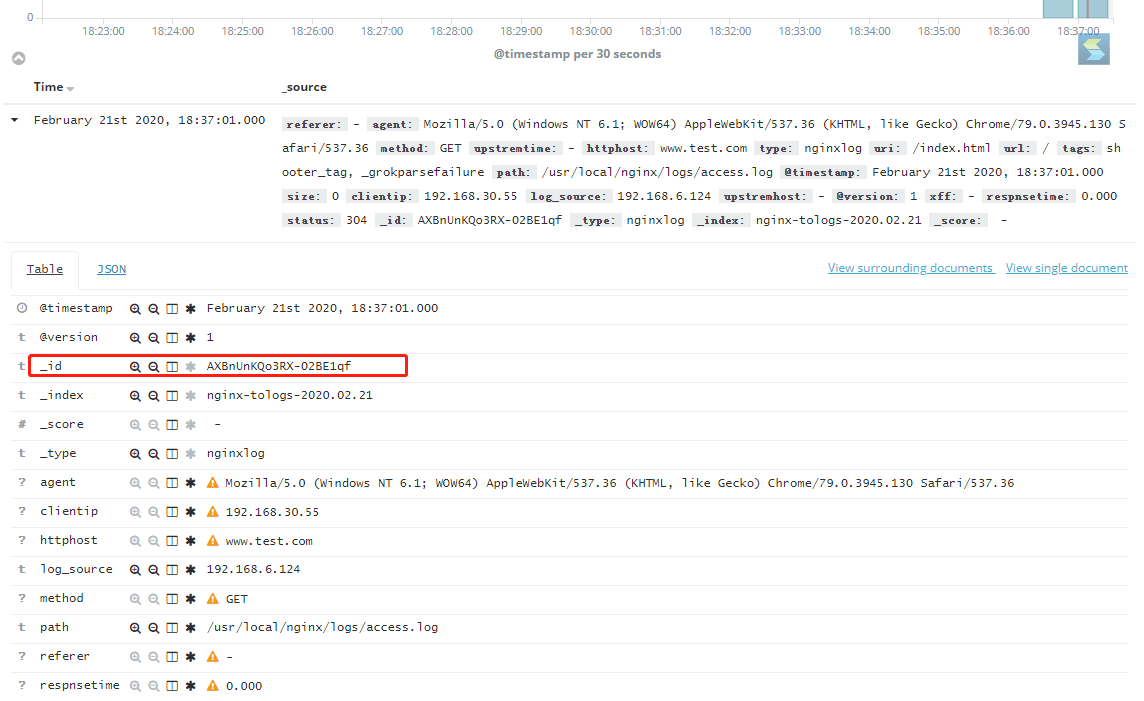

document id 为索引提供id,对重写elasticsearch中相同id词目很有用,但是记住了你提供的这个id不能重复,不能这一条是这个id下一条日志记录还是这个id,这样就会出现数据覆盖,后一条数据永远覆盖前面一条,因为id相同的原因。

来看看你的kibana 日志数据

解决办法:

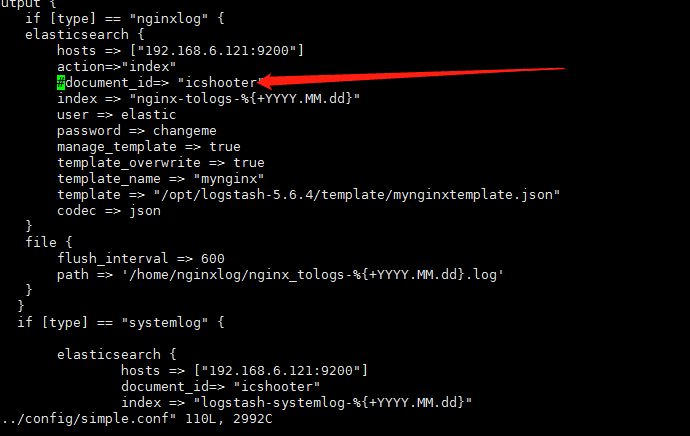

1.注释掉这一项,不设置,让系统默认为每条日志分配id

2.

|

1 2 3 |

document_id对应的就是es的_id,它的值来源于你传入的数据,是动态的。我这边的例子是json的,你参考下:(如果你的json日志值里有这项参数你可以这么干,没有你要想办法,不能照抄) 如传入数据为:{"name":"test1","uuid":"xxx-xxx-xxx"} 此处如果配置为:document_id="%{uuid}",那么es里面的_id对应的就是传入数据的uuid |

继续实验

注释掉这个我们试试

重启logstash

id不重复,数据也不会被覆盖。

(完)

- 本文固定链接: https://www.yoyoask.com/?p=2072

- 转载请注明: shooter 于 SHOOTER 发表